Figure AI to amerykańska firma, która działa na rynku od 2022 roku. To do tego startupu należała jedna z największych rund finansowania robotów humanoidalnych w ubiegłym roku. W lutym firma pozyskała 675 mln dolarów, a jej wartość przekroczyła 2 mld dolarów. Jak wynika z najnowszych informacji przekazanych przez spółkę, nie o same humanoidy chodzi. Startup chce również zadbać o kwestie bezpieczeństwa w związku z wprowadzaniem robotów do miejsc pracy.

W tym celu utworzono wewnętrzny dział, a dokładniej Centrum Zaawansowanego Bezpieczeństwa Humanoidów. Projektem kieruje Rob Gruendel, dawny inżynier ds. bezpieczeństwa w Amazon Robotics. Jest to ważny krok, ponieważ dotychczas Amerykańska Administracja Bezpieczeństwa i Higieny Pracy nie dostosowała swoich standardów dla branży robotyki.

Figure AI zadba o bezpieczeństwo pracowników

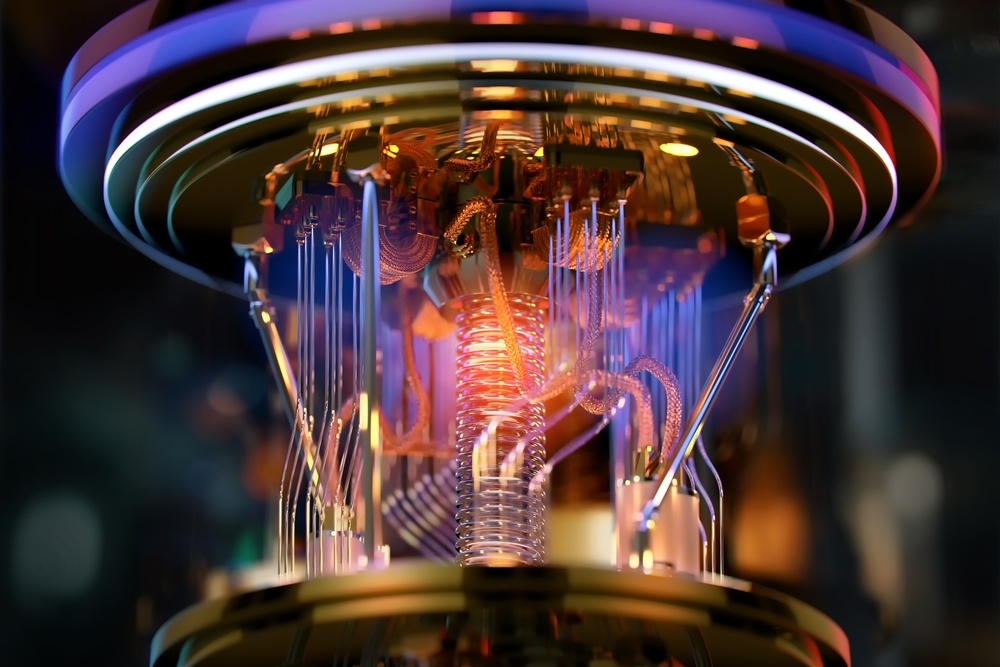

Już w ubiegłym roku rozmówcy MamBiznes często powtarzali, że rewolucja związana ze sztuczną inteligencją postępuje zbyt szybko. Swojego zaskoczenia nie krył Artur Kurasiński. „(…) jestem zaskoczony tempem wprowadzanych zmian. Dokładnie dwa lata temu zadebiutował na rynku ChatGPT i większość spodziewała się, że będzie to niszowe narzędzie. Tymczasem po dwóch miesiącach OpenAI osiągnął liczbę 100 mln użytkowników, co było dotychczasowym rekordem w historii. I myślę, że to był dopiero początek. Każda nowa technologia będzie jeszcze zwiększać tempo rozwoju. Choć za kilka lat sztuczna inteligencja będzie dla społeczeństwa taką samą codziennością, jaką jest obecnie Internet” – wspominał w rozmowie z MamBiznes.

Od kilku dni obserwujemy nowy boom związany z modelem AI stworzonym przez chiński startup DeepSeek. Dlatego w dobie szybko zachodzących zmian kluczowa staje się kwestia bezpieczeństwa społeczeństwa. W przypadku robotów humanoidalnych chodzi o konkretną grupę pracowników.

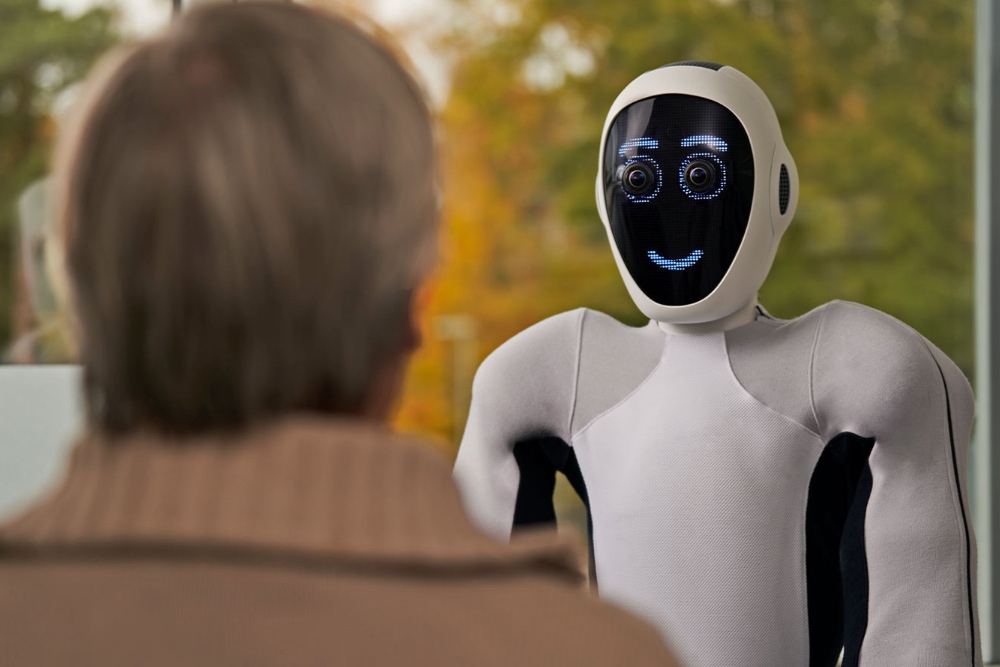

Choć tworzone humanoidy wyróżniają się adaptacyjnością czy wielofunkcyjnością, to ich metalowa budowa może stanowić zagrożenie dla ludzi. Roboty pracujące w fabrykach czy magazynach mogą powodować urazy w wyniku kolizji z pracownikami. Co ciekawe, wspomniana Amerykańska Administracja Bezpieczeństwa i Higieny Pracy nadal nie zadbała o tę kwestię w branży robotyki.

Sprawy w swoje ręce wziął startup Figure AI. W tym celu powołał Centrum Zaawansowanego Bezpieczeństwa Humanoidów. „Chcemy rozmawiać bezpośrednio z naszymi klientami. Będziemy testować i komunikować stabilność robota w bezruchu, stabilność w ruchu, wykrywanie ludzi, wykrywanie czworonożnych zwierząt, bezpieczne zachowania AI oraz nawigację zapobiegającą urazom. Będziemy również słuchać sugestii naszych klientów dotyczących sposobów testowania bezpieczeństwa Figure 02 i kolejnych modeli” – powiedział Rob Gruendel, szef nowego projektu.

W planach Figure AI jest publikacja kwartalnych aktualizacji. Ma ona zapewnić większą przejrzystość procesu. Raporty będą zawierać procedury testowe oraz sposoby eliminowania potencjalnych zagrożeń.

Komentarze

Nie ma jeszcze żadnych komentarzy :)